В июне 2025 года в Лос-Анджелесе прошла серия массовых протестов против беспилотных такси Waymo. Несколько автомобилей были подожжены и уничтожены во время нападений со стороны представителей группы лиц, выражающих коллективное социальное недовольство. В результате компания Waymo временно приостановила работу в центре города и организовала постоянное взаимодействие с правоохранительными органами для обеспечения безопасности. ИНФРАГРИН погрузился в детали противостояния и подготовил обзор о феномене человеческого неприятия и оппозиции новым технологиям.

Где произошли протесты против новых технологий?

Общественность против роботакси в США. В крупных городах, таких как Сан-Франциско и Финикс, жители выражают обеспокоенность быстрым распространением беспилотных такси. Основные претензии связаны с созданием пробок, неустранимым чувством тревоги от «машин-призраков» и опасениями по поводу безопасности и приватности (например, из-за видеонаблюдения с камер машин). Граждане практически повсеместно сообщают о навязчивых звуках машин, которые возникают при их парковке и нарушают сон.

Докеры против беспилотных грузовиков в США. Наиболее показательным примером сопротивления новым технологиям стала забастовка портовых рабочих в США в октябре 2024 года. Почти 50 тыс. работников портов восточного побережья и Мексиканского залива вышли на забастовку, протестуя против внедрения беспилотных грузовиков. Основные требования профсоюза Международной ассоциации докеров (ILA) включали полный запрет на автоматизацию. Работники несли плакаты с надписями «роботы не платят налоги» и «автоматизация вредит семьям».

Таксисты против цифровых платформ в Европе. Хотя прямых массовых протестов против роботизированных такси в Европе пока не зафиксировано, но аналогичные акции здесь регулярно проходят против сервисов, использующих цифровые платформы – таких как Uber. В последние годы таксисты Франции, Германии, Испании, Италии и Великобритании устраивали масштабные забастовки, блокировали дороги, жгли покрышки. Основные причины протестов — опасения за рабочие места, снижение доходов и недовольство отсутствием регулирования новых сервисов.

Правозащитники против ИИ-наблюдения во Франции. Введение в стране закона об ИИ-наблюдении для Олимпийских игр 2025 года вызвало обеспокоенность защитников гражданских прав. Закон разрешает использование алгоритмических инструментов наблюдения в общественных местах для обнаружения подозрительной активности толпы, что делает Францию первой европейской страной, легализовавшей биометрические методы наблюдения.

Аниматоры против ИИ. В июле 2024 года голливудские актеры объявили забастовку против крупных разработчиков видеоигр, включая Activision, Warner Bros и Walt Disney, из-за использования ИИ. Американский профсоюз SAG-AFTRA выразил обеспокоенность тем, что студии используют генеративный ИИ для воспроизведения голосов и внешности актеров без справедливой компенсации. В июне 2025 года на Международном фестивале анимационных фильмов в Анси, Франция, прошли протесты против использования искусственного интеллекта в анимации. Коалиция профсоюзов и международных организаций выпустила заявление о «разрушительном воздействии генеративного искусственного интеллекта на мировую анимационную индустрию».

Международное движение против быстрого развития ИИ. Одним из наиболее организованных движений стала инициатива PauseAI, которая проводит координированные протесты по всему миру с требованием приостановить развитие мощных систем искусственного интеллекта. В феврале 2025 года активисты провели масштабные демонстрации в рамках Парижского саммита по ИИ, организовав протесты в более чем 20 городах мира, включая Париж, Нью-Йорк, Лондон, Берлин, Брюссель, Цюрих, Прагу, Милан, Стокгольм, Копенгаген, Осло и Мельбурн. Активисты утверждают, что политики уделяют недостаточно внимания безопасности ИИ, сосредотачиваясь вместо этого на экономических возможностях и инновациях.

Почему люди считают роботов угрозой

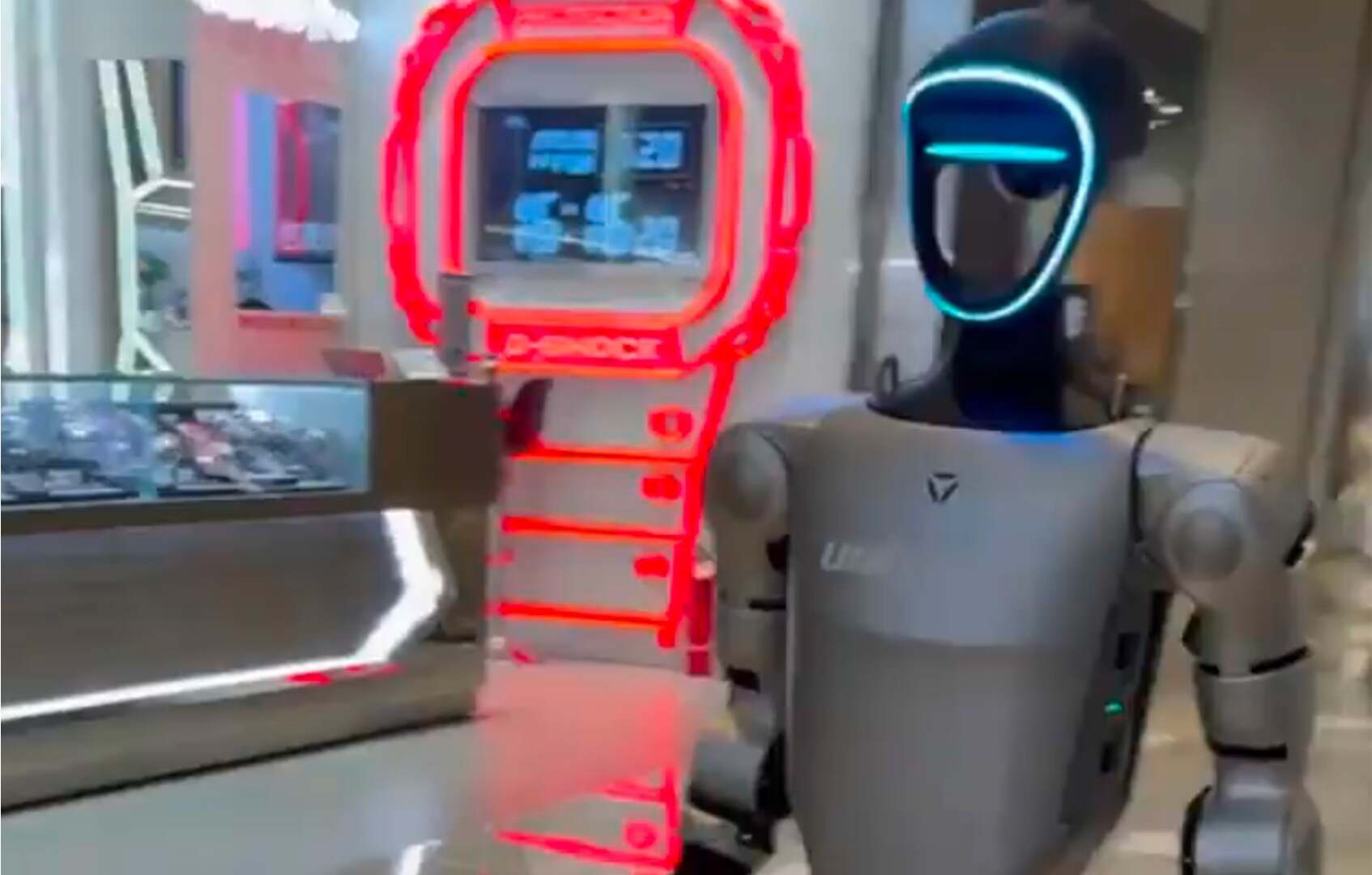

Инциденты с неисправными роботами. В мае 2025 года в Китае произошёл инцидент, когда гуманоидный робот Unitree H1 вышел из строя во время демонстрации и начал агрессивно размахивать руками и ногами, заставив присутствующих людей спасаться бегством. Его изначальная функция ― выполнение простых команд, таких как передвижение грузов. Случай получил большую огласку в СМИ и социальных сетях, что способствует появлению страхов перед «восстанием роботов».

Предупреждения экспертов. Ведущие ученые и технологические лидеры выражают серьезную озабоченность потенциальными угрозами от стремительного развития ИИ. Стивен Хокинг предупреждает, что «развитие полноценного искусственного интеллекта может стать концом человеческой расы». Выдающийся физик опасается, что «такой разум возьмет инициативу на себя и станет сам себя совершенствовать со все возрастающей скоростью». Илон Маск оценивает вероятность уничтожения человечества искусственным интеллектом в 10-20%. Он считает, что «с искусственным интеллектом мы призываем демона» и что эта технология представляет большую угрозу, чем даже оружие.

Экзистенциальные риски. Исследователи выделяют три основные категории экзистенциальных рисков, связанных с развитием ИИ:

– Механические риски связаны с неправильным функционированием ИИ-систем, которые могут привести к критическим ошибкам в промышленных процессах, транспортных системах или медицинских устройствах. Особенно опасны ситуации, когда ИИ принимает решения без человеческого контроля.

– Социальные риски включают углубление социального неравенства и автоматизацию рабочих мест, что может повысить уровень безработицы и создать новые социальные проблемы.

– Этические риски связаны с обработкой больших объемов данных, что создает угрозы утечки личной информации и нарушения приватности.

Психологическая неприязнь. Эффект «зловещей долины» объясняет психологические основы страха перед человекоподобными роботами. Этот феномен, описанный японским инженером Масахиро Мори, возникает, когда «робот или другой объект, выглядящий или действующий примерно как человек (но не точно так, как настоящий), вызывает неприязнь и отвращение у наблюдателей».

Психологи выявили несколько причин этого явления:

1. Отсутствие чувств у объекта — роботы не проявляют эмпатии, что действует отталкивающе.

2. Проблемы с идентификацией — человеческий мозг не может определить, к какой категории отнести объект.

3. Непредсказуемость поведения — невозможность предсказать реакции робота вызывает беспокойство.

Угроза безработицы. Одной из главных причин страха перед роботами является угроза массовой безработицы. По данным Всемирного экономического форума, к 2025 году из-за автоматизации могут быть сокращены 85 млн рабочих мест в 15 сферах экономики. Хотя ожидается создание 97 млн новых рабочих мест, «появление новых позиций будет происходить медленнее, чем исчезновение уже существующих». Исследования Oxford Economics показывают ещё более масштабные прогнозы: к 2030 году роботы могут оставить без работы около 20 млн людей.

Культурный код. Страх перед роботами значительно усиливается влиянием популярной культуры. Как отмечают исследователи, на разум людей повлияли фантастические фильмы о восстании роботов». Такие фильмы, как «Терминатор» и «Матрица» сформировали в массовом сознании образ роботов как потенциальную угрозу для человечества.

Как контролировать новые технологии и искусственный интеллект?

Международные соглашения и конвенции. Рамочная конвенция Совета Европы об искусственном интеллекте и правах человека стала первым международным юридически обязывающим договором в сфере ИИ. Принятая 24 мая 2024 года и подписанная 15 правительствами, включая США, Великобританию, Канаду, Японию, Израиль и страны ЕС, конвенция устанавливает принципы, направленные на снижение рисков для прав человека, демократии и верховенства права.

Документ применяет основанный на оценке рисков подход к проектированию, разработке, использованию и выводу из эксплуатации систем. Среди ключевых принципов: уважение человеческого достоинства и автономии, прозрачность и надзор, отсутствие дискриминации, защита приватности, надежность и безопасность инноваций.

Глобальный цифровой договор ООН. В сентябре 2024 года 143 государства из 193 проголосовали за принятие Глобального цифрового договора (Global Digital Compact, GDC) в рамках «Саммита будущего» ООН. Договор устанавливает набор общемировых принципов для управления цифровыми технологиями, включая ответственное использование ИИ.

ГЦД предусматривает создание независимой Международной научной группы по ИИ, которая объединит экспертов из разных стран и будет работать при поддержке учреждений ООН. Договор также предполагает начало межправительственного диалога по вопросам управления ИИ для обмена опытом и создания совместимых мер регулирования.

Закон о регулировании ИИ в Европе. AI Act Европейского союза — первый в мире всеобъемлющий закон об искусственном интеллекте — вступет в силу поэтапно с февраля 2025 года. Закон применяет риск-ориентированный подход, классифицируя ИИ-системы на четыре категории: от полностью запрещенных до требующих соблюдения общих принципов.

С 2 февраля 2025 года начали действовать запреты на использование ИИ-систем, признанных представляющими неприемлемый риск, включая системы социального скоринга, манипулирования поведением и биометрической идентификации в реальном времени в общественных местах. 2 августа 2025 года вступят в силу правила для систем ИИ общего назначения.

Однако реализация AI Act сталкивается с серьезным сопротивлением со стороны технологических гигантов. Крупнейшие IT-компании, включая Google, Amazon, Apple и европейские корпорации вроде Bosch, призывают ЕС заморозить ключевые положения закона, ссылаясь на неясные формулировки, высокую административную нагрузку и риски потери конкурентоспособности.

Трехэтапная модель в Китае. Китай демонстрирует уникальный подход, сочетающий строгий государственный контроль с поддержкой инноваций. С августа 2023 года действуют 24 правила регулирования ИИ, включающие обязательную регистрацию услуг и алгоритмов, маркировку контента, созданного ИИ, и требование использовать только «законные данные» для обучения моделей.

Китайский подход отличается трехэтапной моделью: начальная либерализация для ускорения инноваций, усиление контроля при выявлении рисков, и стабилизация нормативной базы. Такой подход позволяет балансировать между технологическим прогрессом и социальным контролем.

Проект закона в России. В России разрабатывается проект федерального закона о регулировании систем искусственного интеллекта в рамках выполнения Национальной стратегии развития ИИ до 2030 года. Документ предлагает ввести базовые определения, обязательную маркировку систем ИИ и классификацию по уровням риска.

Международный саммит по стандартам ИИ. Первый в мире Международный саммит по стандартам ИИ пройдёт 2-3 декабря 2025 года в Сеуле. Организованный Международной организацией по стандартизации (ISO), Международной электротехнической комиссией (IEC) и Международным союзом электросвязи (ITU), саммит станет платформой для разработки совместимых стандартов ИИ.

Событие является прямым ответом на призыв ООН к действиям по совершенствованию управления ИИ с помощью международных стандартов и призвано обеспечить надежность, устойчивость и соблюдение прав человека при использовании ИИ.

Каковы проблемы и вызовы глобального регулирования

Одной из главных проблем является значительная фрагментация международного законодательства об ИИ. США, Китай, Индия, Россия и другие страны разрабатывают собственные подходы на основе баланса между стимулированием инноваций и обеспечением контроля, однако в каждой стране требования отличаются друг от друга. Компании, работающие на глобальном рынке, оказываются в сложном положении: как обеспечить соответствие десяткам различных, порой противоречащих друг другу, требований?

Координация отсутствует и в системе ООН. Хотя многие подразделения организации затрагивают вопросы управления новыми технологиями и ИИ, их конкретные мандаты означают, что ни одна из них не занимается этим комплексно. Возможно, в недалеком будущем человечество наметит еще одну согласованную цель устойчивого развития – цель безопасного и человекоориентированного искусственного интеллекта.

Материал подготовлен с использованием публикаций BBC, Time, Pause AI, UNA-UK, The Verge.

Фотобанк Росконгресс / Санкт-Петербург, КВЦ «Экспофорум» / 19.06.2025 / Автор: Сергей Кулаков